생성 모델2021

디퓨전 모델 (Diffusion Models)

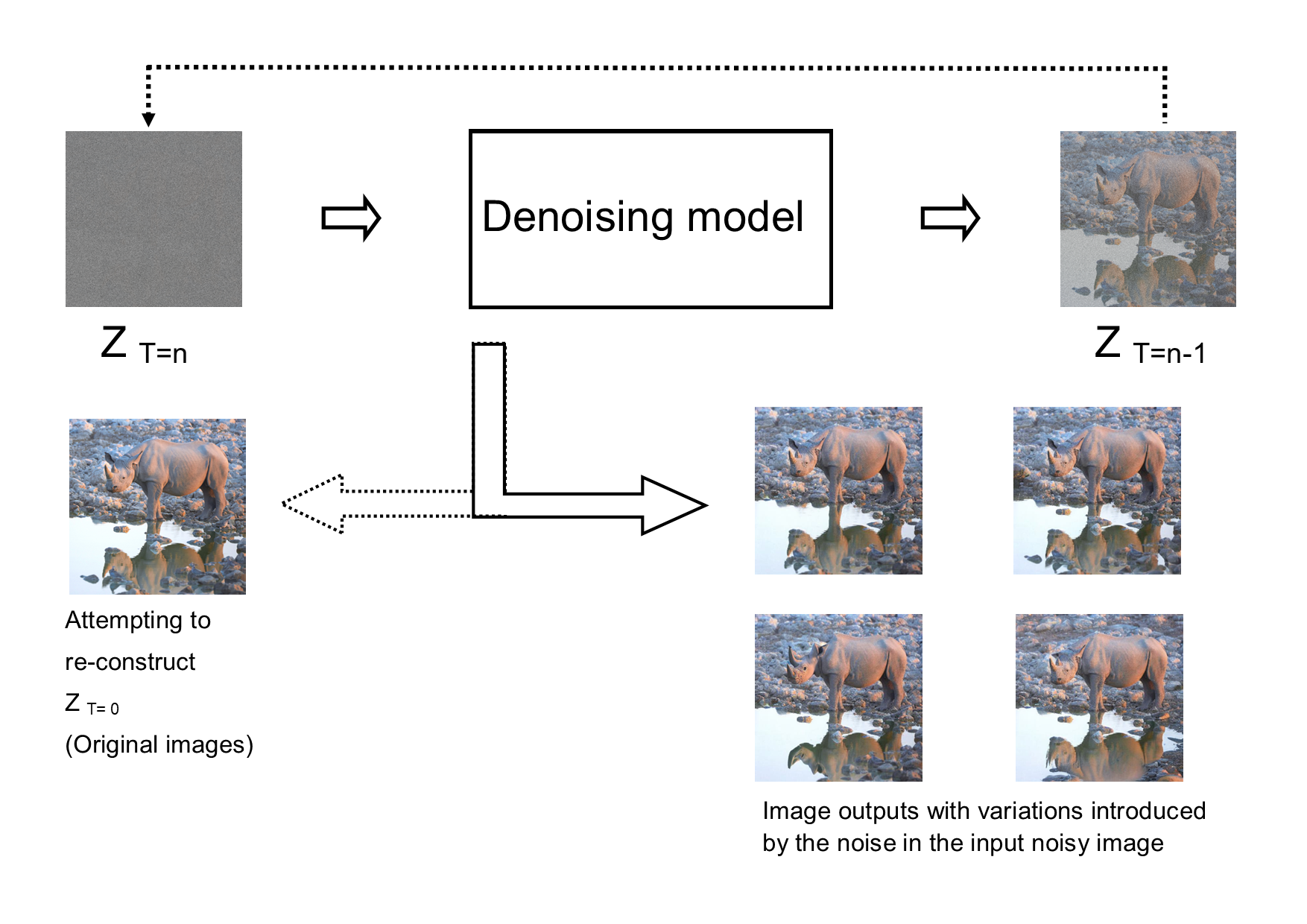

조나단 호 등이 노이즈 제거 과정으로 고품질 이미지를 생성하는 DDPM을 발표

디퓨전 모델: 전방 과정(노이즈 추가) → 역방향 과정(노이즈 제거)으로 이미지 생성 (Wikimedia Commons)

디퓨전 모델은 데이터에 점진적으로 노이즈를 추가한 뒤, 그 역과정을 학습합니다. DALL-E 2, Stable Diffusion 등의 기반 기술입니다.

핵심 수식

전방 과정

xₜ=t 시점의 데이터 (노이즈가 추가된 상태)

xₜ₋₁=이전 시점의 데이터 (조금 더 깨끗한 상태)

βₜ=노이즈 스케줄 — t 시점에서 추가할 노이즈 양 (0~1)

𝒩=가우시안(정규) 분포 — 노이즈는 랜덤으로 추가

√(1-βₜ)=원본 신호의 유지 비율 — βₜ가 크면 원본이 더 많이 사라짐

역방향 과정

p_θ=신경망(θ)이 학습한 역방향 확률 분포

μ_θ(xₜ, t)=신경망이 예측한 평균값 — '노이즈 제거 후 이미지는 이럴 것'

σₜ²=역방향 과정의 분산 — 복원의 불확실성

θ=학습 가능한 신경망 파라미터

핵심 개념

전방 과정(Forward)

데이터에 가우시안 노이즈를 점진적으로 추가하는 과정

역방향 과정(Reverse)

노이즈를 단계적으로 제거하며 데이터를 복원하는 학습 과정

잠재 공간 디퓨전(LDM)

픽셀 대신 압축된 잠재 공간에서 디퓨전을 수행 → Stable Diffusion의 핵심

주요 인물

로

로빈 롬바흐

Stable Diffusion / Latent Diffusion 논문 1저자

조

조나단 호

DDPM 논문 저자, 디퓨전 모델 부흥의 시작

영향 & 의의

GAN을 대체하는 이미지 생성의 새 표준. Stable Diffusion, DALL-E, Midjourney 등 생성형 AI 열풍의 기반 기술이 되었습니다.

용어집

DDPMDenoising Diffusion Probabilistic Model

노이즈 제거 확산 확률 모델. 디퓨전 모델의 현대적 재발견 (2020, 조나단 호)

LDMLatent Diffusion Model

잠재 공간 디퓨전. 픽셀 대신 압축된 잠재 벡터에서 디퓨전 수행 → Stable Diffusion의 핵심

노이즈 스케줄Noise Schedule (βₜ)

각 타임스텝에서 추가할 노이즈의 양을 정의하는 시퀀스

U-NetU-Net

인코더-디코더 구조의 신경망. 디퓨전에서 노이즈를 예측하는 역할

CFGClassifier-Free Guidance

분류기 없는 가이던스. 텍스트 조건의 영향력을 조절하여 생성 품질 향상